系列之三|模型架構|分層控制、VLA 與多模態融合

人類之所以靈活,並不是因為我們只有一顆更大的腦,而是因為我們會分工。

走路的時候,我們不會每一步都重新思考;伸手拿杯子時,也不會每一次都像第一次學抓握。很多動作早已沉進肌肉記憶,像水流進舊河道,一到那裡,身體自己就知道該怎麼走。可一旦情況變了,例如地板突然濕滑、手裡的杯子開始打滑、前方有人撞過來,我們的大腦又會立刻接手,把原本平靜的動作重新拉回控制。

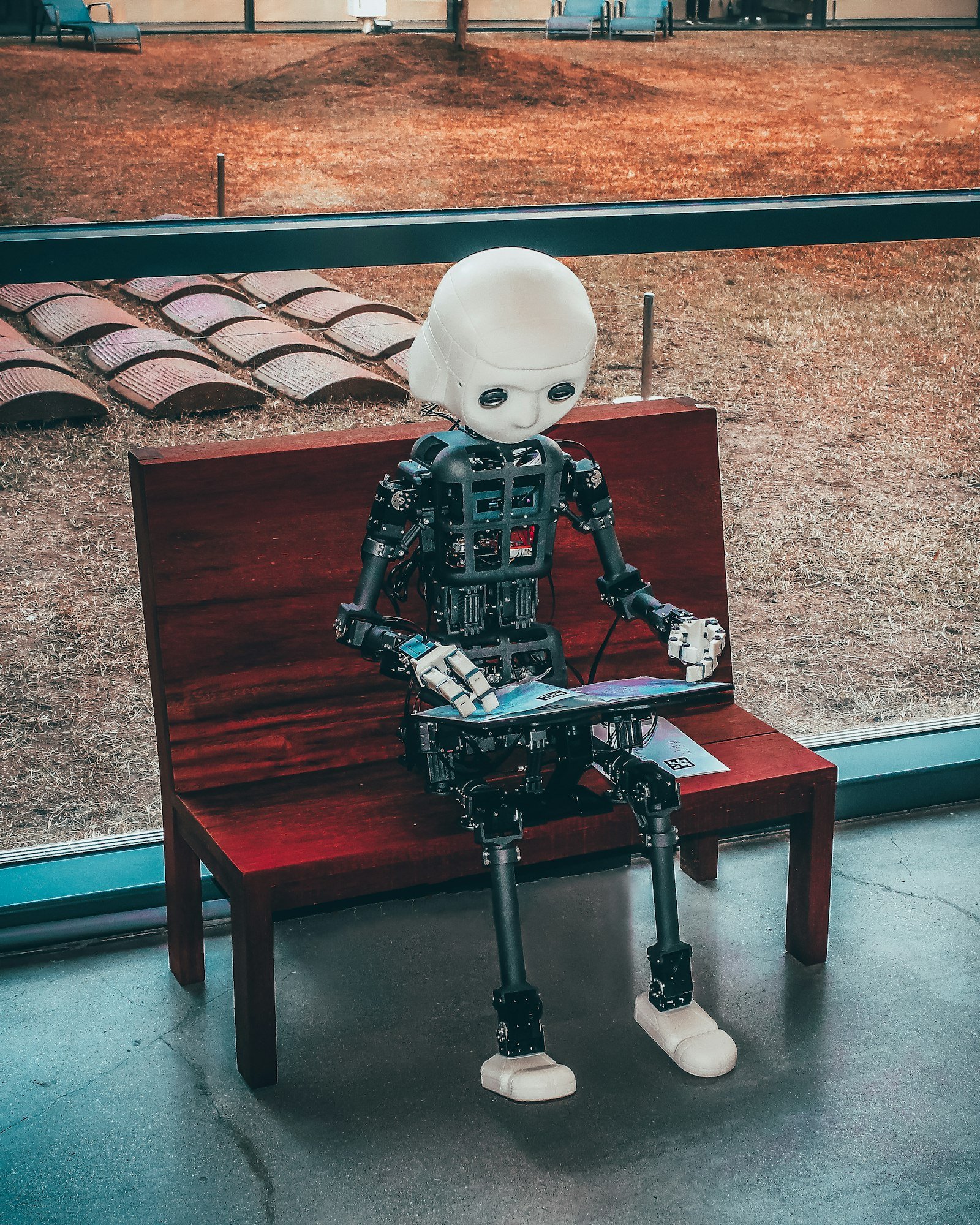

這件事聽起來平常,卻正是今天機器人正在學的一門課。

過去很多機器人系統像是一個單線條的執行器:看見、判斷、動作,全擠在同一個控制邏輯裡。這樣的系統能做事,但很難同時兼顧靈活、穩定、即時與泛化。於是現在越來越多具身智能系統開始往一個更像人類的方向走:不是做一顆更大的腦,而是做一個會分工的腦。

這就是為什麼近年大家開始反覆談到:大小腦、快慢腦、VLA、多模態控制、觸覺融合,甚至更遠一點的類腦設計。這些詞看起來分散,其實都在回答同一個問題:

機器人怎麼從「會動」,變成「會做事」?

答案不是更大的單體,而是更好的分工。也正因如此,今天除了 VLA(Vision-Language-Action),也開始有人往 VLAW(Vision-Language-Action-World Model)這條線走:不只讓機器把看見、理解與動作接起來,還想替它補上一層對世界持續演變的內部模型。說得更白一點,就是不只讓它會做,還想讓它對「這個世界接下來會怎麼變」有更穩的預期。

一、大小腦,其實不是比喻,而是一種工程誠實

所謂「大小腦」,表面上是在借用生物學的語言,實際上是在描述機器人控制架構的一個核心事實:不同層次的問題,不該由同一層系統硬扛。

高層負責的是:

- 理解任務

- 判斷目標

- 決定步驟

- 推理環境

- 在多個可能性中選一條路

低層負責的是:

- 關節控制

- 平衡維持

- 步態調節

- 力道輸出

- 局部修正

- 毫秒級回饋控制

如果把這兩件事全塞在同一套機制裡,結果通常會兩頭不到岸。高層太慢,低層等不起;低層太細,高層看不見全局。最終系統不是反應太鈍,就是控制太碎,像一個同時要當將軍、參謀、司機、士兵的人,什麼都做,什麼都做不漂亮。

所以「大小腦」最重要的地方,不在詞,而在它承認了一個現實:

機器人不是只要聰明就好,它還需要把聰明放到對的層次上。

這是一種工程上的誠實。因為真實世界不是單一尺度的問題,而是一層包一層、快慢交錯、局部與全局同時存在的系統。

二、快慢腦:真正的差別,不是速度,而是責任

「快慢腦」看起來像在講算力,實際上講的是責任分配。

快的那一層,通常處理的是來不及等的事情。像關節的微調、平衡修正、手指夾持力的改變、接觸後的即時反應。這些事情不是不能思考,而是不能慢慢想。它們需要的是低延遲、閉環、幾乎像反射一樣的能力。

慢的那一層,則是在做另一種工作。它要理解更大的上下文:

- 我現在在做什麼任務?

- 下一步該先處理哪個物體?

- 這個房間的結構大概是什麼?

- 我應該走哪條路,才比較穩、比較安全、比較省動作?

這種分工其實跟人很像。

我們端盤子時,並不是每 10 毫秒都用意識重新規劃一次手腕角度。大部分時候,手臂和腿會自己調整;只有當情況突然改變,例如旁邊有人撞一下,我們的高層注意力才會瞬間被拉過去。

對機器人來說,若這種快慢分工做不好,系統就會出現一種很常見的笨重感:看起來每一步都知道自己要去哪,卻走得像每一步都在重新學。這不是因為它沒有模型,而是因為它還沒有真正建立「肌肉記憶」與「主動思考」之間的邊界。

所以快慢腦的重要性,不只是提升效率,而是讓機器人開始有機會從「每次都重算」走向「知道何時該重算,何時不必」。

三、VLA 為什麼重要?因為它讓「看懂」開始接上「做到」

如果說大小腦與快慢腦是在談控制的分層,那麼 VLA(Vision-Language-Action)則是在嘗試打通另一條斷裂已久的管線:

從看見,到理解,到做出動作。

過去很多系統的問題在於,它們雖然會看,也雖然會動,但中間像隔著一道牆。視覺是視覺,控制是控制,語言是語言,三者像住在同一棟樓裡的陌生人,彼此能遞紙條,卻很難真正同桌工作。

VLA 的價值,就在於它試圖把這些本來分散的能力接起來。不是只有知道桌上有一個杯子,而是知道那是一個可以被拿起來、可以被端走、可能裝著水、需要輕拿輕放的物體。不是只有理解「幫我把桌面整理乾淨」這句話,而是能把語言目標拆成感知與行動鏈條。更重要的是,它讓機器人第一次比較像在處理「任務」,而不只是處理「座標」。

這一步很重要,因為它讓機器人第一次有機會不只是把世界當成座標系,而是開始把世界當成任務空間。

而一旦這件事成立,模仿學習、示範學習與影片學習的意義也會一起被放大。因為模型開始不只是學一個固定動作,而是學一種「從人的行為裡抽出任務結構」的能力。它不一定完全懂人,但它開始比較有機會把人的示範,轉成自己可調用的技能片段。

也就是說,VLA 最迷人的地方不是它「比較像人」,而是它讓機器人更有可能把抽象指令翻譯成現實裡連續而具體的行動。

而 VLAW 若真的成熟,意義會再往前推一步。因為很多任務不是只有「現在該怎麼做」,還包括「做了之後世界會變成什麼樣子」、「下一秒哪個風險會長出來」、「眼前這個局部動作會不會在三步之後反咬自己」。世界模型之所以重要,不是因為它聽起來更聰明,而是因為真實世界本來就不會停下來等你計算。

當然,這條路還遠沒有走完。今天很多 VLA 系統,仍然存在:

- 在受控環境表現較好

- 對長鏈任務穩定性不足

- 對感測噪聲與干擾敏感

- 落地到複雜場景時,常需要大量工程補丁

但即便如此,VLA 依然是一個分水嶺。因為它至少正在證明一件事:

機器人不必永遠活在「感知」和「控制」彼此割裂的時代。

四、只有視覺還不夠,觸覺會把機器人拉回真實

人類非常依賴視覺,這沒有錯。可如果真的去看一個人在做事,會發現我們不是靠眼睛一個人在撐。

我們拿杯子時會「感覺」滑不滑;折衣服時會「感覺」布料有沒有展開;插接零件時會「感覺」卡榫是不是對上;提袋子時會「感覺」重量是不是偏向某一邊。很多關鍵判斷,都是視覺先給方向,觸覺再做最後確認。

這也是為什麼,機器人若想真正進入複雜現場,只靠視覺通常是不夠的。

視覺能告訴你:

- 東西在哪裡

- 大概長什麼樣

- 可能怎麼移動

但觸覺能補上的,是另一層更貼近身體的世界:

- 它是不是滑

- 是不是軟

- 接觸位置有沒有偏

- 施力夠不夠

- 物體是不是正在變形

你提到 VTLA 這類把觸覺也整合進來的方向,雖然現在還不一定是最統一、最穩定的主流術語,但它所指向的趨勢是清楚的:

未來的機器人模型,不會只滿足於「看見世界」,而會越來越想「摸到世界」。

這件事一旦往前推,意義很大。因為很多過去在視覺上模模糊糊的事情,一碰就知道。衣服材質不同,要不要烘乾;握力應不應該增加;物體有沒有鬆動;抓住的是表面還是重心,這些都不是靠更高畫素就能完全解決的。

觸覺不是視覺的附庸,它更像是把機器人的世界,從螢幕拉回皮膚。

五、類人腦設計最容易被說得浪漫,也最需要被拉回工程

每當一個產業剛開始長肉,總會有一些詞先長出翅膀。

類人腦、突觸式架構、自我生成小模型、神經形態設計,這些概念都很迷人,也確實可能對未來有啟發。但它們很容易被說成像已經站在門口,實際上很多還只是剛在遠處亮起燈。

這裡最需要警惕的,不是它們完全沒價值,而是把「方向」誤寫成「現況」。

比較穩妥的理解方式是:

- 大小腦、快慢腦:已經是很有工程實感的設計方向

- VLA:已經是具身模型的重要主線

- 觸覺融合:前沿且值得注意,但仍在走向更穩定落地

- 類腦、突觸、自發生成新模型:更像中長期願景或研究方向,不能直接包裝成現成產業能力

- 任務小模型、技能庫與可調用技能片段:很可能會成為中間層的重要務實解法

技術進步最怕的,不是想像太遠,而是把還在遠方的事,提前寫成腳下已經有的路。那會讓整個討論失真,也會讓真正重要的工程問題被浪漫話語蓋過去。

所以如果要把「類人腦設計」寫進文章裡,最好的寫法不是宣布它已成熟,而是承認:

機器人正在往更像分工體系、而不是單一控制器的方向演化;至於是否會真正走向類腦結構,仍需很長時間驗證。

這樣比較穩,也比較真。

六、真正成熟的機器人,不會每一步都重新學一次

今天很多機器人的一個共同特徵,是看得出來它很努力。

它不是沒有能力,而是每一步都像在重新確認:我是不是該往前?我是不是該再抬高一點?我是不是該再轉一下?這種感覺很像一個每走一步都要查一次地圖的人。不是不會走,而是不夠自然。

所以未來的關鍵,不只是讓模型知道更多,而是讓模型把某些能力沉下去。沉成反射,沉成低階控制,沉成不必每次都開會決定的本能。

人類的「熟練」本質上就是一種壓縮。我們把很多反覆發生的控制問題,從高成本的意識層,壓進了低成本的身體層。於是寫字不需要重新學筆畫,騎腳踏車不需要重新推演平衡,拿筷子也不需要每一頓飯都像第一次。

機器人未來若要真正成熟,也必須經歷這個過程:

- 高層負責新任務、新情境與策略選擇

- 低層負責已學會的穩定控制

- 模型不必每次從零出發,而能調用已有技能片段

- 在變與不變之間,找到足夠靈活又足夠節能的分界

這也是為什麼近年的模仿學習、示範學習、影片學習與泛化能力會變得格外重要。真正成熟的機器人,不該每到一個新場景就像失憶一次;它要能從人的示範、從過往軌跡、甚至從影片裡抽出可遷移的技能片段,然後在新桌面、新工位、新房間裡重新組合。所謂泛化,說穿了不是什麼神祕天賦,而是系統終於有能力把「以前學過的」帶去「眼前沒見過的」地方。

而這裡很可能不會只有一個萬能總模型在工作。更現實的場景,反而像一個層級分明的技能體系:上層模型理解任務與情境,下層是一批更小、更專、更快的小模型或技能模組,各自處理抓取、平衡、步態、局部修正與特定工具使用。這樣的系統不一定最浪漫,卻更可能最先成熟。

換句話說,真正好的架構,不是讓機器人每次都顯得很聰明,而是讓它在大部分時候,不需要一直顯得那麼費力。

七、從工程的角度看,機器人不是需要一顆超級腦,而是一個會協調的內閣

如果一定要替今天的機器人架構找一個比喻,那我會說,它更像內閣,而不是皇帝。

不是所有事都由一個中心說了算,而是:

- 有負責長程規劃的部門

- 有負責即時反應的部門

- 有負責感測整合的部門

- 有負責動作執行的部門

- 有負責把老經驗沉澱成日常慣性的部門

這種系統看起來複雜,卻可能比一個巨大而單一的控制器更穩。因為真實世界本來就複雜,只有承認複雜,系統才有機會變得自然。

這也是為什麼,今天真正值得關注的,不只是誰的模型參數更多,而是誰開始把整個控制架構做得更像一個有層次、有分工、有快慢邊界、有感知閉環的系統。

未來機器人的成熟,也許不會先表現在一句最聰明的回答上,而會先表現在:

它終於不再每一步都像第一次學走路。

八、結語:不是更大的腦,而是更好的分工

回頭看這波具身智能浪潮,很多人自然會把注意力放在最醒目的地方:模型、算力、參數、語言能力、推理能力。可如果要問機器人到底怎麼從「能展示」走向「能工作」,答案也許比想像中樸素。

不是把一顆腦做得無限大。

而是學會分工。

學會讓高層做高層該做的事,低層做低層該做的事;學會讓快的控制快,慢的思考慢;學會讓視覺不再孤單,讓觸覺開始加入;學會把反覆訓練過的動作沉成慣性,把真正陌生的情境留給更高層判斷。

人類之所以看起來自然,不是因為我們每一刻都在全力思考,而是因為我們知道什麼該交給身體,什麼該交給意識。機器人若想變得更像一個真正能工作、能協作、能走進現場的系統,最後也會走向這條路。

所以從大小腦到 VLA,真正重要的,不是術語本身有多新,而是它們都在指向同一件事:

機器人正在學的,不只是動作,而是分工。

等到它真的學會分工,具身智能才會開始從聰明,慢慢變得可靠。

而當分工開始成立,下一個產業問題就會跟著冒出來:不同模組、不同設備、不同廠商做出來的系統,能不能彼此接上?那正是下一篇要談的:互操作、標準與機器人世界的共通語言。